上下文管理

若想深入了解 Cursor 中上下文的工作原理,请参阅我们的《上下文使用指南》。

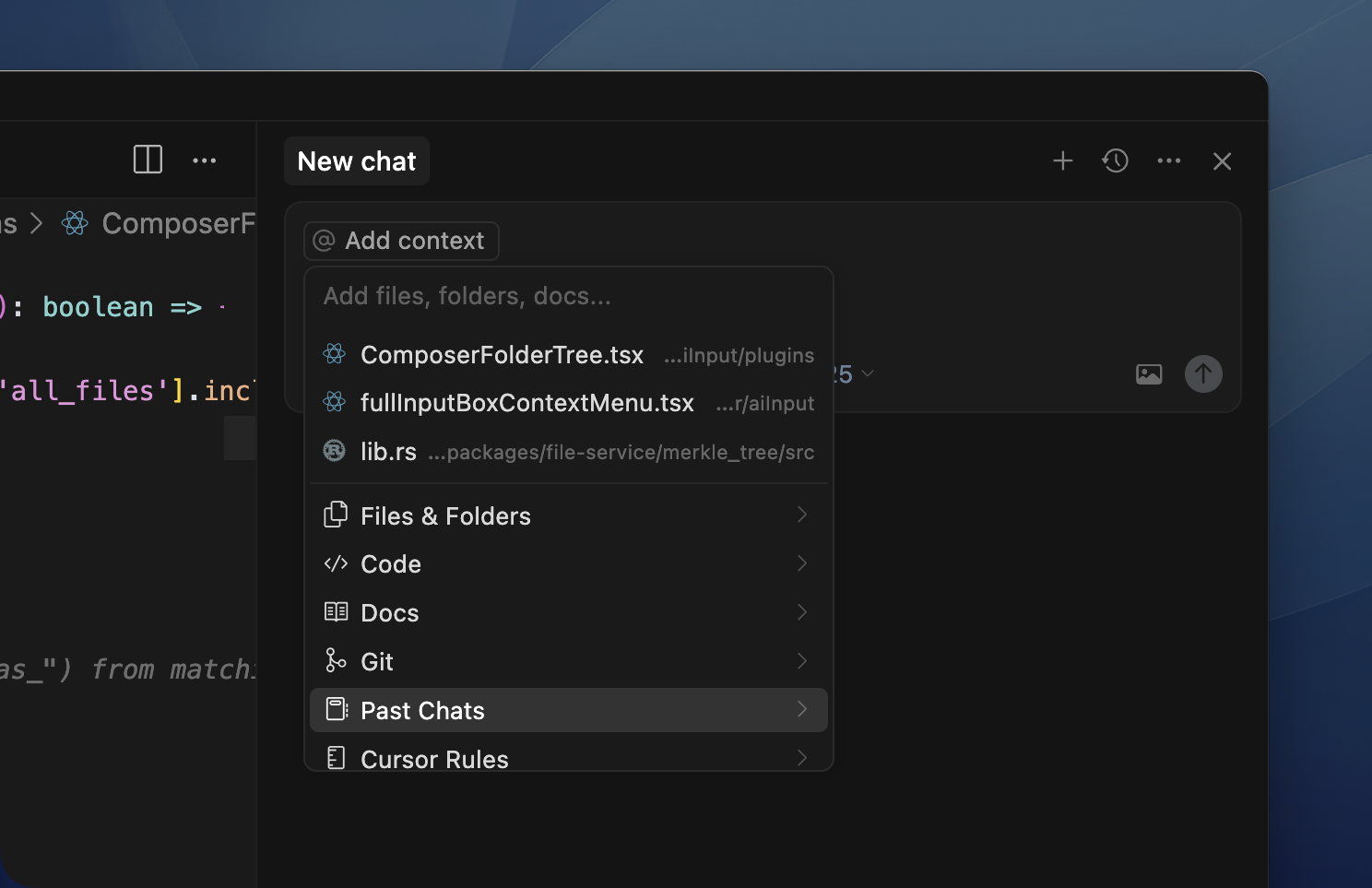

菜单

通过上下文菜单,您可以自由选择需要发送给模型的内容。

状态解读

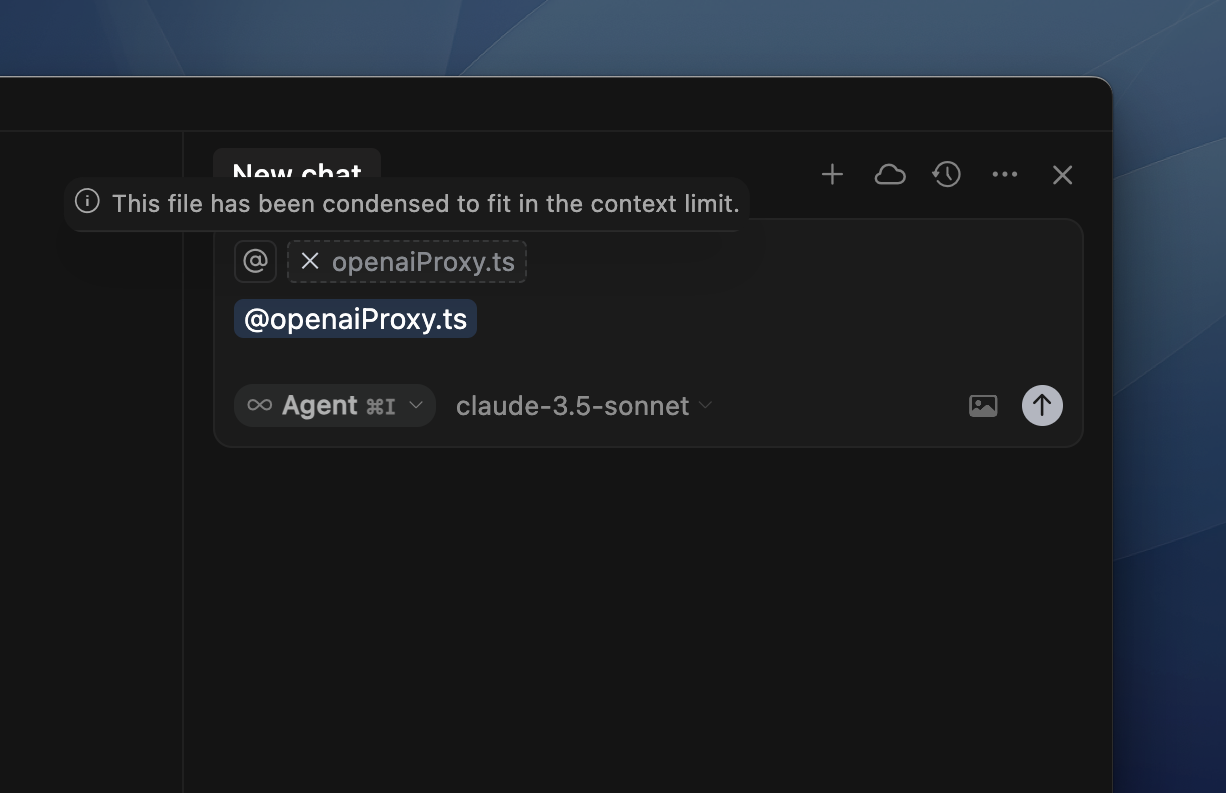

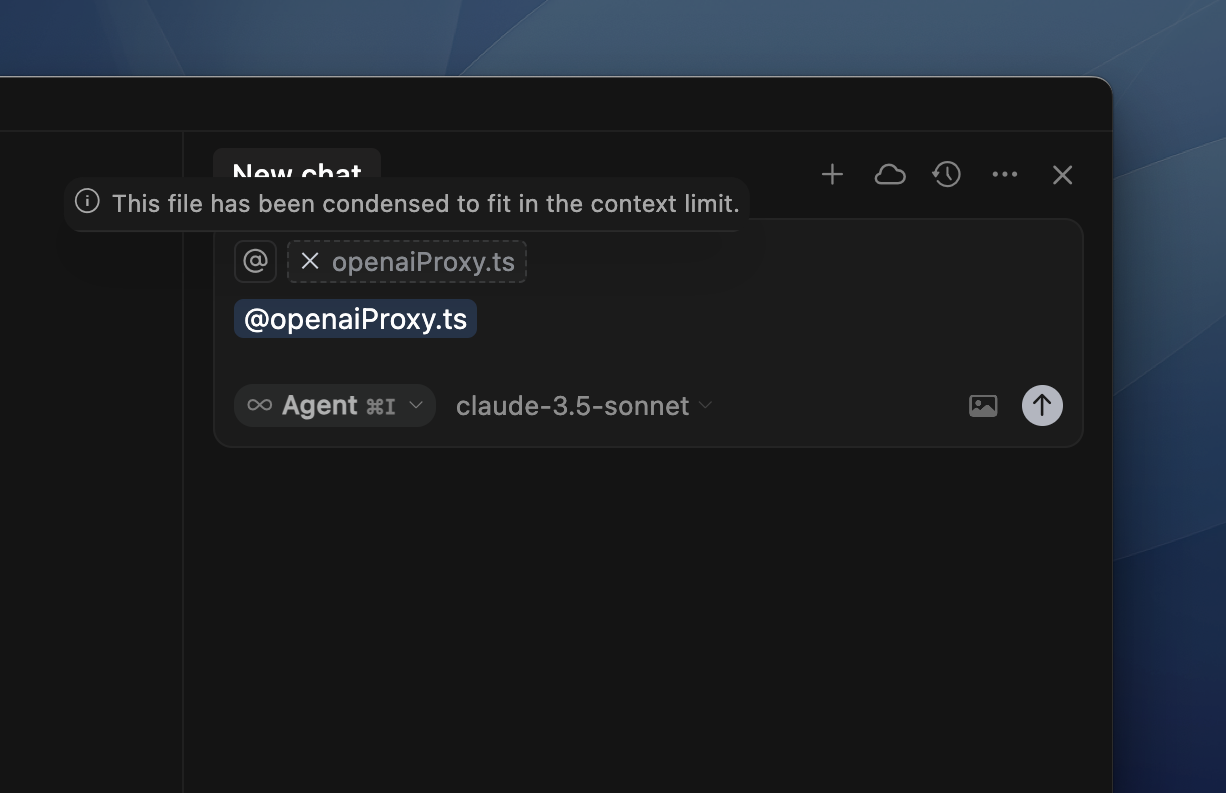

精简模式(Condensed)

当文件或文件夹过大,无法完全放入上下文窗口时,Cursor 会自动启用精简模式。该模式会向模型展示关键结构元素,如函数签名、类定义和方法声明。基于这种精简视图,模型可根据需要选择展开特定文件。这种智能压缩机制能最大化利用有限的上下文窗口空间。

深度精简模式(Significantly Condensed)

当文件名称旁出现"深度精简"标签时,表示该文件体积过大,即使经过精简处理也无法完整展示。此时模型仅能查看文件名信息。

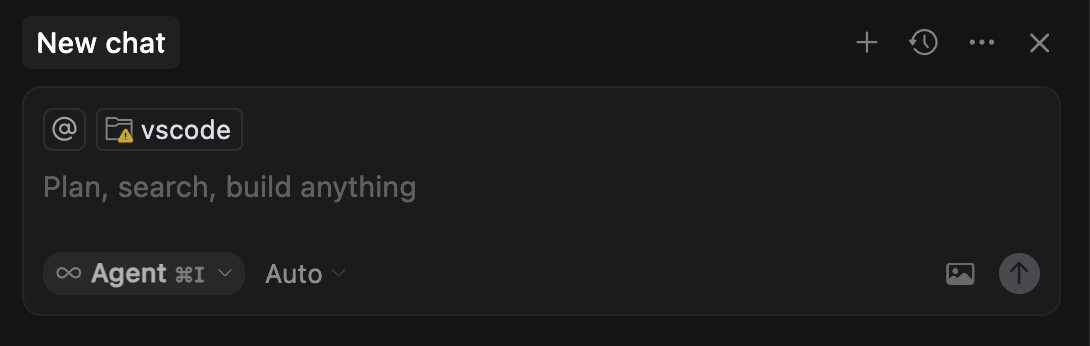

未包含项(Not included)

当文件或文件夹旁出现警告图标时,表示该条目过大,无法被纳入上下文窗口中(即使以压缩形式呈现)。这有助于您了解当前代码库中哪些部分对模型具有可访问性。

摘要(Summarization )

所有模型都存在有限的上下文窗口(例如 200k token),为了生成响应,模型必须将所有输入内容(包括用户消息、附加文件及图像等)和输出内容(回答及工具调用)都容纳在这个窗口内。当对话持续进行过多轮次后,上下文窗口会被逐渐填满,直至模型完全失去响应空间。

当上下文窗口即将满载时,Cursor 会自动对对话内容进行总结,以确保模型拥有足够的响应空间。我们会尽可能保留重要信息,但不可避免地需要舍弃部分内容。您可能会观察到模型似乎遗忘了早期对话中的某些信息,或重复读取相同内容等现象。虽然这种机制并非完美,但相比完全无法响应的情况,仍属于更优的解决方案。

如何避免内容被自动摘要?

您可以尝试以下几种方法:

- 开启新的对话:如果正在处理新任务,请开启新的对话。当上下文环境中没有先前任务的无关信息时,通常能获得更好的结果,同时也能显著降低触及上下文窗口容量限制的风险。

- 使用更大上下文窗口的模型:请参考模型页面查看不同模型及其上下文窗口容量(例如 GPT-4 支持 128k tokens 的超长上下文)。

- 减少显式上下文引用:例如减少附加文件数量,让 AI 代理自主判断是否需要读取更多文件。

- 切换至 MAX 模式:该模式通常提供更大的上下文窗口容量,特别适合处理复杂代码场景。

专业建议

对于大型代码库操作,建议优先使用 Composer 功能进行结构化代码管理,同时结合 行内聊天 进行精准上下文交互,可有效提升 AI 对代码意图的理解准确率。